TESTING

Automated testing to validate user experiences across real devices, networks, and channels.

Features

CHANNELS

Dans un monde où les applications sont déployées plusieurs fois par jour et où les architectures microservices dominent le paysage technologique, la qualité logicielle ne peut plus être une réflexion tardive. La Qualité Continue (Continuous Quality ou CQ) s'impose comme une pratique stratégique qui transforme fondamentalement la manière dont les organisations conçoivent, développent et maintiennent leurs produits numériques.

La Qualité Continue est une approche d'ingénierie qui consiste à mesurer, surveiller, améliorer et déboguer la qualité logicielle tout au long du cycle de développement. Contrairement aux méthodes traditionnelles où les tests interviennent en fin de cycle, la CQ évalue la qualité à chaque modification du code, créant ainsi une boucle de feedback permanente.

Cette évolution répond à des enjeux business concrets : dans un contexte où le software est au cœur de secteurs critiques comme la santé ou la finance, et où l'expérience utilisateur détermine le succès commercial, garantir une qualité irréprochable n'est plus optionnel. C'est devenu un avantage concurrentiel décisif.

Summary

1.

I. MESURER : Comprendre l'état réel de la qualité

2.

II. AUTOMATISER : Détecter les problèmes au plus tôt

3.

III. AMÉLIORER : Une démarche collective et continue

4.

La qualité continue : un avantage concurrentiel durable

5.

6.

7.

8

9.

10.

Le paysage du développement logiciel a radicalement changé ces dernières années, créant de nouveaux défis pour maintenir un niveau de qualité élevé.

La complexité des architectures distribuées est le premier défi majeur. L'adoption massive des microservices a fragmenté les applications monolithiques en dizaines, voire centaines de services indépendants. Chaque équipe travaille sur sa portion de code, déployant ses changements de manière autonome. Si cette approche apporte agilité et scalabilité, elle rend également difficile la compréhension de l'impact global d'une modification. Un changement apparemment anodin dans un microservice peut avoir des répercussions en cascade sur l'ensemble du système.

Le rythme effréné des déploiements continus ajoute une couche de complexité supplémentaire. Quand le code est poussé en production plusieurs fois par jour, identifier précisément quel changement a provoqué une dégradation devient un véritable casse-tête. La traçabilité et la corrélation entre modifications et incidents deviennent essentielles.

La dispersion des données de qualité constitue un autre obstacle majeur. Les informations sur la qualité sont éparpillées à travers différentes étapes du cycle de développement : résultats de tests unitaires ici, rapports d'analyse statique là, métriques de performance ailleurs. Cette fragmentation empêche d'avoir une vision globale et cohérente de l'état réel du produit. Sans cette vue d'ensemble, il devient impossible d'identifier les tendances, d'anticiper les problèmes ou de prioriser les efforts d'amélioration.

La qualité logicielle ne se limite pas à l'absence de bugs ou à la conformité aux standards de codage. La véritable mesure de la qualité réside dans l'expérience que vivent les utilisateurs finaux au quotidien.

Au-delà des métriques techniques, il est crucial de comprendre comment les utilisateurs perçoivent et interagissent avec le produit. Un code parfaitement testé peut toujours produire une expérience frustrante si les temps de réponse sont trop longs, si l'interface manque de fluidité, ou si les fonctionnalités ne répondent pas aux attentes réelles. La Qualité Continue doit donc intégrer des indicateurs centrés sur l'utilisateur : taux de satisfaction, temps de complétion des tâches, taux d'abandon, ou encore feedback qualitatif.

Le feedback loop devient alors central. Plutôt que d'attendre les remontées du support client ou les mauvais avis sur les stores, la CQ implique de mettre en place des mécanismes de retour d'information en temps réel. Cela permet de détecter immédiatement quand un changement dégrade l'expérience utilisateur, même si techniquement tout semble fonctionner correctement.

Le monitoring et l'observabilité en production ne sont plus des options mais des impératifs. La qualité doit être surveillée dans les conditions réelles d'utilisation, avec de vrais utilisateurs, sur de vrais appareils, dans de vraies conditions réseau. C'est à ce niveau que se révèlent les problèmes de performance, les incompatibilités, ou les comportements inattendus qui n'apparaissent jamais en environnement de test.

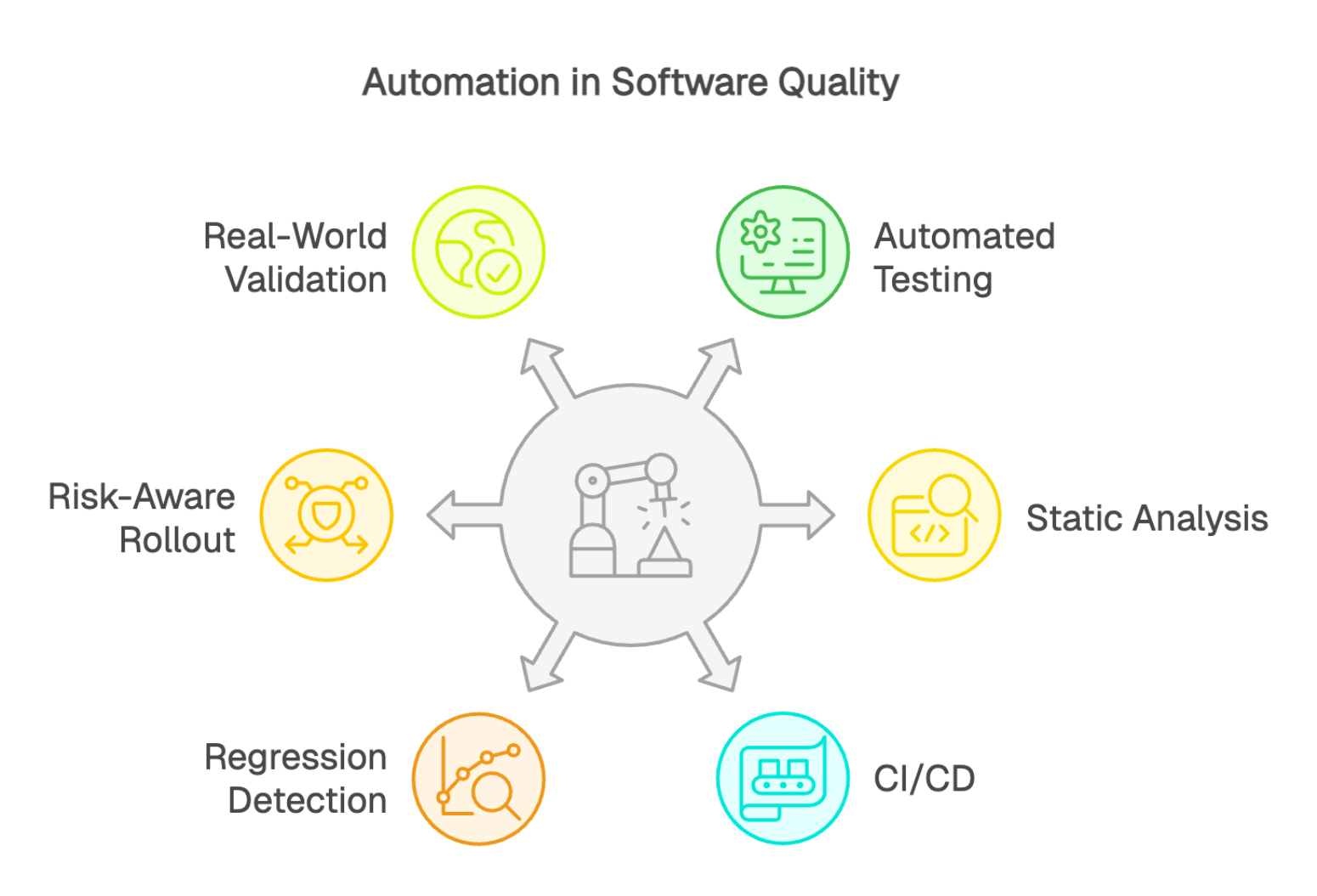

L'automatisation est le pilier qui rend la Qualité Continue opérationnellement viable. Sans elle, maintenir un niveau de qualité élevé à un rythme de déploiement soutenu serait tout simplement impossible.

Les tests automatisés forment la première ligne de défense. Une stratégie de test complète doit couvrir différents niveaux : tests unitaires pour valider la logique des composants individuels, tests d'intégration pour vérifier les interactions entre services, et tests end-to-end pour simuler des parcours utilisateurs complets. L'objectif n'est pas d'automatiser pour automatiser, mais de créer une suite de tests qui apporte un feedback rapide et fiable sur l'état du système.

L'analyse statique et les revues de code permettent d'identifier les problèmes avant même l'exécution. Les outils d'analyse détectent les violations de standards, la complexité excessive, les vulnérabilités de sécurité potentielles, ou les patterns de code problématiques. Couplées à des revues entre pairs, ces pratiques garantissent que seul du code de qualité est intégré dans la base principale.

L'intégration et le déploiement continus (CI/CD) orchestrent l'ensemble du pipeline qualité. Chaque modification de code déclenche automatiquement une chaîne d'opérations : compilation, tests, analyses, packaging, et déploiement. Cette automatisation garantit la reproductibilité et élimine les erreurs humaines liées aux processus manuels.

Automatiser les tests ne suffit pas si on ne comprend pas l'impact réel des modifications sur le système global.

La détection automatique des régressions est essentielle dans un contexte de changements fréquents. Les systèmes modernes doivent être capables de comparer automatiquement les performances et le comportement avant et après chaque changement, identifiant ainsi les dégradations potentielles. Cela inclut non seulement les bugs fonctionnels, mais aussi les régressions de performance, d'accessibilité ou d'utilisabilité.

L'évaluation des risques avant déploiement permet de prendre des décisions éclairées. En analysant la nature des changements, leur portée, et leur impact potentiel sur les services dépendants, il devient possible d'adapter la stratégie de déploiement : déploiement progressif pour les changements à risque, rollback automatique en cas d'anomalie, ou validation supplémentaire pour les modifications critiques.

Les tests en conditions réelles complètent les tests traditionnels. Il s'agit de vérifier le comportement du logiciel dans son environnement réel de production, avec de vraies données, de vrais utilisateurs, et des conditions réseau variables. Cette approche révèle des problèmes impossibles à détecter dans des environnements de test contrôlés. En mesurant la qualité d'expérience (QoE) directement depuis les devices des utilisateurs, des solutions comme Kapptivate offrent une visibilité inégalée sur les performances réelles et permettent d'identifier les points de friction avant qu'ils n'impactent massivement la satisfaction client.

La Qualité Continue transcende les silos organisationnels traditionnels. Elle ne peut être l'apanage d'une seule équipe ou d'un seul rôle.

Impliquer toutes les parties prenantes est fondamental. Les développeurs doivent penser qualité dès l'écriture du code. Les équipes opérationnelles doivent intégrer la qualité dans leurs processus de déploiement et de surveillance. Les product managers doivent définir des critères de qualité alignés avec les attentes utilisateurs. Les designers UX doivent penser aux implications qualitatives de leurs choix. Cette approche holistique crée une culture où chacun se sent responsable de la qualité finale.

Construire une culture de la qualité nécessite plus que des processus. Il faut des outils qui rendent la qualité visible, accessible et actionnable pour tous. L'infrastructure doit faciliter les bonnes pratiques plutôt que de les imposer par la contrainte. L'objectif est de rendre le testing "fun, rapide et hautement efficace", comme le souligne l'article source, pour que la qualité devienne naturelle plutôt que perçue comme une charge.

De la supervision à l'amélioration continue, la démarche CQ ne se contente pas de détecter les problèmes. Elle met en place des mécanismes d'apprentissage et d'amélioration. Chaque incident devient une opportunité d'améliorer les processus, d'enrichir les tests, ou d'affiner les alertes. Cette boucle vertueuse transforme progressivement l'organisation en une machine à produire de la qualité.

C'est peut-être l'insight le plus important de la Qualité Continue : le déploiement n'est pas une fin, mais un commencement.

Le monitoring post-production et les alertes temps réel sont cruciaux. Une fois en production, le logiciel doit être surveillé en permanence pour détecter tout comportement anormal : pics de latence, augmentation du taux d'erreurs, crashes, ou dégradation de l'expérience utilisateur. Ces informations doivent être immédiatement accessibles et actionnables, permettant une réponse rapide avant que les problèmes n'impactent massivement les utilisateurs.

L'analyse des incidents et l'apprentissage qui en découle constituent un élément clé de l'amélioration continue. Chaque problème rencontré en production doit être analysé en profondeur : quelle en était la cause racine ? Pourquoi n'a-t-il pas été détecté plus tôt ? Quels tests auraient pu le prévenir ? Cette analyse post-mortem, sans blâme mais focalisée sur l'amélioration, renforce progressivement la robustesse du système.

La boucle de feedback continue avec les utilisateurs ferme le cycle de la Qualité Continue. Les retours utilisateurs, qu'ils soient quantitatifs (métriques d'usage) ou qualitatifs (feedbacks directs), doivent alimenter directement les prochaines itérations. Cette connexion directe entre ce que vivent les utilisateurs et ce que produisent les équipes garantit que la qualité technique se traduit effectivement en qualité d'expérience.

La Qualité Continue représente bien plus qu'une évolution des pratiques de test. C'est un changement de paradigme dans la manière de concevoir et de délivrer des logiciels dans un monde où la rapidité et la fiabilité doivent coexister.

Les bénéfices business sont tangibles et mesurables : cycles de développement plus rapides sans compromis sur la stabilité, réduction drastique du coût de correction des bugs (détectés plus tôt), amélioration de la satisfaction client grâce à une expérience plus fluide et fiable, et réduction des risques liés aux déploiements.

L'approche holistique est essentielle. La Qualité Continue ne fonctionne pleinement que lorsqu'elle relie qualité du code, robustesse de l'infrastructure, et expérience utilisateur réelle. C'est cette vision end-to-end, depuis l'écriture du code jusqu'à l'usage en production, qui fait toute la différence.

Dans un marché ultra-compétitif, où les utilisateurs ont des attentes toujours plus élevées et des alternatives toujours plus nombreuses, la Qualité Continue n'est plus un luxe technique. C'est un avantage concurrentiel stratégique. Les organisations qui l'embrassent pleinement, qui en font une culture plutôt qu'un processus, sont celles qui réussiront à délivrer de la valeur rapidement tout en maintenant la confiance et la satisfaction de leurs utilisateurs.

La qualité n'est jamais un accident. Elle est le résultat d'une intention claire, d'efforts soutenus, et d'une vigilance constante. La Qualité Continue fournit le cadre, les outils et la philosophie pour faire de cette aspiration une réalité opérationnelle.